Nhắc tới công cụ tìm kiếm, có rất nhiều thuật ngữ mới lạ bạn sẽ nghe thấy. Và Googlebot cũng là một trong số các thuật ngữ đó. Để giúp bạn hiểu rõ hơn bài viết này sẽ giải thích khái niệm Googlebot là gì.

Qua bài viết này bạn sẽ hiểu:

- Khái niệm về Googlebot

- Cách Googlebot hoạt động

- Tầm quan trọng của Googlebot đối với website

- Cách tối ưu hóa cho Googlebot

Googlebot là gì?

Googlebot thường được gọi là con nhện tìm kiếm, hoặc được gọi là bot thu thập thông tin hoặc dữ liệu trên website. Googlebot là một chương trình do Google phát triển được thiết kế để khám phá các website trên internet.

Theo định nghĩa trên tài liệu chính thức của Google thì:

Googlebot có một số công việc quan trọng:

- Khám phá các trang web để theo dõi các bài viết mới, để tìm và lập chỉ mục cho các nội dung đó.

- Thu thập thông tin về mỗi trang mà Googlebot tìm thấy, luôn giữ cho cơ sở dữ liệu của Google được cập nhật mới nhất.

Quá trình thu thập dữ liệu của Googlebot không bao giờ kết thúc. Googlebot sẽ di chuyển từ trang này sang trang khác và ghi nhận lại các thông tin mà nó tìm thấy trong quá trình tìm kiếm thông tin. Tất nhiên Googlebot có khả năng thu thập dữ liệu với kích thước lớn và có thể thu thập dữ liệu một trang web nhiều lần, nhưng không hề cố định vào khoảng thời gian cụ thể nào.

Và cuối cùng, Googlebot được Google chạy trên nhiều máy chủ ở những nơi khác nhau để có thể khám phá và lập chỉ mục càng nhiều web càng tốt.

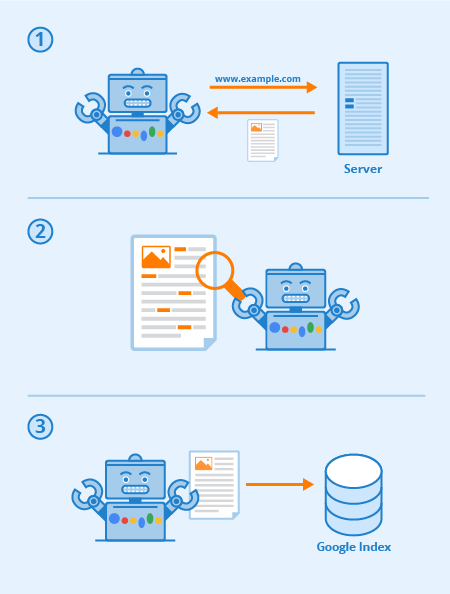

Googlebot hoạt động như thế nào?

Trong quá trình khám phá, Googlebot sử dụng sơ đồ trang web và cơ sở dữ liệu của các liên kết được tìm thấy để xác định các vị trí tiếp theo.

Hiểu một cách đơn giản hơn đó là bất kỳ lúc nào Googlebot tìm thấy các liên kết mới (có thể là liên kết hình ảnh, liên kết trên thanh điều hướng, trên anchor text hoặc thông qua các liên kết ẩn bằng JavaScript có thể đọc được) trên một website, nó sẽ thu thập thông tin và thêm chúng vào danh sách các trang để truy cập tiếp theo. Nếu Googlebot phát hiện ra những thay đổi trong các liên kết hoặc liên kết bị lỗi, nó sẽ ghi chú lại và cập nhật vào chỉ mục.

Ảnh hưởng của Googlebot đối với trang web của bạn

Có thể chắc chắn rằng Googlebot sẽ tìm thấy trang của bạn không sớm thì muộn nên về mặt lý thuyết bạn không cần làm gì cả. Tuy nhiên ở khía cạnh của SEO, bạn cần Googlebot ghi nhận những thay đổi trên website của mình nhanh hơn để có thể được tái lập chỉ mục và có thể xếp hạng cao hơn sau mỗi lần chính sửa.

Hãy tưởng tượng nếu Googlebot không thể truy cập vào website của bạn hoặc khi khả năng thu thập dữ liệu của nó bị hạn chế. Chắc chắn rằng khi đó website của bạn rất khó để có được thứ hạng cao bởi Google không thể hiểu rõ Website của bạn có những thông tin gì.

Tối ưu hóa cho Googlebot tức là bạn đang giúp Google thu thập thông tin từ website của bạn dễ dàng hơn và điều này giúp tăng khả năng hiển thị các kết quả trên bảng xếp hạng tìm kiếm (SERP).

Khả năng thu thập thông tin đề cập tới mức độ truy cập mà Googlebot có đối với toàn bộ trang web của bạn. Hệ thống càng dễ sàng lọc nội dung thì hiệu suất của bạn trong SERP sẽ càng tốt hơn.

Tuy nhiên, Googlebot có thể bị chặn bởi website của bạn hoặc từ hệ thống máy chủ. Một số tình huống phổ biến bạn có thể gặp đó là những lỗi từ DNS, firewall.

Cách để cải thiện tốc độ thu thập thông tin cho trang web

Vì sao Googlebot thu thập thông tin chậm?

Qua một số tìm hiểu của tôi trên Google for Developers, YoastSEO cùng một số trang tin tức hàng đầu về SEO,v.v..v…, một số yếu tố khiến Googlebot thu thập dữ liệu chậm như sau:

|

Yếu tố |

Nguyên nhân |

|

Máy chủ phản hồi chậm |

Mỗi website có một “ngân sách crawl”, tức là số lượng trang mà Google cho phép bot thu thập trong một phiên. Nếu server phản hồi chậm:

Ví dụ: Một trang web thương mại điện tử có 10.000 URL. Nhưng do server phản hồi trung bình mất 2 giây/trang, Googlebot chỉ thu thập được 300–400 trang/ngày. Trong khi nếu server phản hồi 200ms/trang, bot có thể thu thập > 5.000 trang/ngày. |

|

Nhiều lỗi và đường dẫn hỏng |

|

|

URL quá nhiều/ không cần thiết |

1. Giới hạn ngân sách thu thập dữ liệu (Crawl Budget)Googlebot chỉ dành một lượng tài nguyên nhất định để thu thập dữ liệu từ mỗi trang web. Nếu trang web có quá nhiều URL, đặc biệt là các URL trùng lặp, kém chất lượng hoặc không cần thiết, ngân sách thu thập sẽ bị phân tán. Kết quả là:

2. Tăng độ phức tạp trong việc thu thập dữ liệuKhi số lượng URL tăng đột biến hoặc có quá nhiều biến thể URL (do tham số URL, session ID, phân trang…), Googlebot cần xử lý nhiều hơn để xác định đâu là nội dung quan trọng. Điều này gây chậm trễ trong quá trình xử lý và thu thập. 3. Ảnh hưởng đến hiệu quả lập chỉ mụcGoogle có thể đánh giá rằng một website với quá nhiều URL kém chất lượng đang cố tình thao túng hệ thống, dẫn đến việc hạn chế thu thập hoặc ưu tiên thu thập ít hơn để tiết kiệm tài nguyên. 4. Tăng khả năng gặp lỗi kỹ thuậtNhiều URL không cần thiết cũng có thể dẫn đến lỗi 404, redirect loop, hoặc timeout. Những lỗi này khiến Googlebot phải xử lý lại hoặc bỏ qua, kéo theo việc thu thập bị gián đoạn hoặc chậm lại. |

|

robots.txt/phân quyền sai |

Nếu tệp robots.txt chặn truy cập vào các thư mục quan trọng hoặc chứa lỗi cú pháp, Googlebot có thể hiểu nhầm rằng nó không được phép truy cập vào website, từ đó bỏ qua việc thu thập dữ liệu. Ví dụ: Một dòng như Disallow: / trong robots.txt sẽ khiến toàn bộ website bị chặn khỏi việc thu thập thông tin. |

|

Website không mobile-friendly |

|

|

JS/phân mảnh tải nội dung phức tạp |

Googlebot thu thập chậm khi website dựa quá nhiều vào JavaScript là vì:

|

|

Site mới/ít link chất lượng |

Lý do là vì Googlebot hoạt động ưu tiên theo tín hiệu liên kết và lịch sử truy cập. Không có liên kết nghĩa là không có “đường đi”, và không có tín hiệu phổ biến thì cũng không có lý do để Googlebot dành tài nguyên crawl thường xuyên. |

Làm thế nào để tối ưu tốc độ Googlebot?

Tối ưu cấu trúc website

Việc tối ưu cấu trúc website giúp Googlebot dễ dàng thu thập và hiểu nội dung trang, từ đó tăng hiệu quả crawl. Một cấu trúc rõ ràng, với các liên kết nội bộ hợp lý và phân cấp danh mục logic, cho phép Googlebot nhanh chóng khám phá các trang mới và ưu tiên các trang quan trọng. Điều này giảm thời gian Googlebot cần để lập chỉ mục và cải thiện khả năng hiển thị trên công cụ tìm kiếm.

Ví dụ: Một website bán hàng có cấu trúc phân cấp như “Trang chủ > Danh mục sản phẩm > Loại sản phẩm > Sản phẩm cụ thể” với menu điều hướng rõ ràng, sử dụng breadcrumb và liên kết nội bộ để kết nối các sản phẩm liên quan, giúp Googlebot dễ dàng thu thập tất cả các trang sản phẩm.

Nâng cấp tốc độ tải trang

Tốc độ tải trang nhanh giúp Googlebot thu thập nhiều trang hơn trong thời gian ngắn, đặc biệt với các website lớn có crawl budget giới hạn. Google ưu tiên các trang tải nhanh vì chúng cải thiện trải nghiệm người dùng và giảm tải cho máy chủ của Googlebot. Bằng cách áp dụng các kỹ thuật tối ưu hóa, website có thể giảm thời gian tải, giúp Googlebot truy cập và lập chỉ mục nhiều trang hơn trong một phiên thu thập.

Mẹo để nâng cấp tốc độ tải trang:

- Nén hình ảnh: Sử dụng công cụ như TinyPNG hoặc plugin WP Smush để giảm kích thước file hình ảnh mà vẫn giữ chất lượng, giúp giảm thời gian tải.

- Sử dụng bộ nhớ đệm (caching): Cài đặt plugin như WP Rocket hoặc W3 Total Cache để lưu trữ phiên bản tĩnh của trang, giảm thời gian xử lý máy chủ.

- Giảm thiểu CSS/JavaScript: Loại bỏ khoảng trắng, chú thích và mã không cần thiết trong CSS/JavaScript bằng công cụ như Autoptimize hoặc UglifyJS.

- Sử dụng Content Delivery Network (CDN): Tích hợp Cloudflare hoặc Akamai để phân phối nội dung từ máy chủ gần người dùng nhất, giảm độ trễ.

- Tối ưu hóa cơ sở dữ liệu: Dọn dẹp cơ sở dữ liệu bằng cách xóa các bản sửa đổi bài viết cũ hoặc dữ liệu rác, sử dụng plugin như WP-Optimize.

- Bật nén Gzip: Kích hoạt nén Gzip trên máy chủ để giảm kích thước file HTML, CSS và JavaScript khi truyền tải.

- Tải chậm (lazy loading): Áp dụng lazy loading cho hình ảnh và video để chỉ tải nội dung khi người dùng cuộn đến, giảm tải ban đầu.

- Sử dụng hosting chất lượng cao: Chọn máy chủ có tốc độ phản hồi nhanh (như SiteGround hoặc Kinsta) để xử lý yêu cầu nhanh hơn.

Giảm thiểu lỗi kỹ thuật

Lỗi kỹ thuật như liên kết bị hỏng, lỗi 404, hoặc chuyển hướng không đúng có thể làm gián đoạn quá trình thu thập của Googlebot, dẫn đến lãng phí crawl budget. Việc sửa chữa các lỗi này đảm bảo Googlebot có thể truy cập và lập chỉ mục mọi trang mà không gặp trở ngại. Sử dụng công cụ như Google Search Console, hoặc Screaming Frog để phát hiện và khắc phục lỗi là cách hiệu quả để duy trì hiệu suất crawl.

Cập nhật nội dung thường xuyên

Cập nhật nội dung thường xuyên giúp website duy trì tính mới mẻ, thu hút Googlebot quay lại crawl thường xuyên hơn, từ đó tăng cơ hội lập chỉ mục nhanh chóng. Điều này bao gồm việc thêm nội dung mới, chỉnh sửa nội dung cũ để cập nhật thông tin hoặc tối ưu SEO, và đảm bảo nội dung phù hợp với nhu cầu người dùng. Một chiến lược cập nhật hiệu quả giúp Google nhận diện website là nguồn thông tin đáng tin cậy, ưu tiên thu thập.

Cách cập nhật nội dung thường xuyên

- Đăng bài viết mới: Tạo bài blog, bài tin tức, hoặc sản phẩm mới theo lịch trình đều đặn (ví dụ: 2-3 bài/tuần) để cung cấp nội dung tươi mới.

- Cập nhật bài viết cũ: Thêm thông tin mới, sửa số liệu lỗi thời, hoặc tối ưu từ khóa cho các bài viết hiện có để giữ tính liên quan.

- Thêm nội dung đa phương tiện: Bổ sung hình ảnh, video hoặc infographic mới vào các trang để tăng giá trị và thu hút Googlebot.

- Tạo các trang theo mùa hoặc xu hướng: Đăng nội dung liên quan đến sự kiện, ngày lễ, hoặc xu hướng thị trường để thu hút sự chú ý.

- Tái cấu trúc nội dung: Sắp xếp lại các bài viết liên quan thành cụm chủ đề (topic cluster) với liên kết nội bộ để tăng độ sâu crawl.

- Xóa hoặc chuyển hướng nội dung lỗi thời: Xóa các trang không còn giá trị và chuyển hướng 301 đến trang liên quan để tối ưu crawl budget.

Kiểm soát file robots.txt và thẻ meta robots

File robots.txt và thẻ meta robots giúp quản lý hành vi của Googlebot, cho phép hoặc chặn thu thập các trang không cần thiết, từ đó tối ưu hóa crawl budget. Đảm bảo file robots.txt không chặn các trang quan trọng và sử dụng thẻ meta noindex cho các trang không cần lập chỉ mục giúp Googlebot tập trung vào nội dung giá trị.

Tăng crawl budget cho website lớn

Crawl budget là số lượng trang mà Googlebot thu thập trong một khoảng thời gian nhất định, đặc biệt quan trọng với các website lớn có hàng nghìn trang. Tăng crawl budget bằng cách cải thiện chất lượng nội dung, tăng liên kết nội bộ, và gửi sitemap XML thường xuyên giúp Googlebot thu thập nhiều trang hơn.

Ví dụ: Một website thương mại điện tử với 10.000 sản phẩm gửi sitemap XML hàng tuần qua Google Search Console và tối ưu liên kết nội bộ, giúp Googlebot thu thập thêm 20% số trang mỗi tháng.

Có bao nhiêu loại Googlebot?

Theo tài liệu chính thức của Google, có hơn 16 loại Googlebot, nhưng dưới đây là những loại quan trọng nhất đối với SEO.

Trên thực tế, không chỉ có một loại Googlebot duy nhất. Google triển khai nhiều loại bot chuyên biệt để thu thập thông tin theo từng loại nội dung: văn bản, hình ảnh, video, tin tức… Việc hiểu rõ bot nào đang truy cập vào website giúp bạn kiểm soát tốt hơn tài nguyên, hạn chế lỗi hiển thị và tránh lãng phí ngân sách crawl.

|

Tên Bot |

User-Agent (rút gọn) |

Mục đích chính |

|

Googlebot (desktop) |

Googlebot/2.1 |

Thu thập nội dung cho kết quả tìm kiếm trên máy tính |

|

Googlebot (mobile) |

Googlebot/2.1 (Mobile) |

Quan trọng nhất hiện nay – quyết định khả năng hiển thị trên mobile |

|

Googlebot Image |

Googlebot-Image/1.0 |

Thu thập hình ảnh để hiển thị trong Google Hình ảnh |

|

Googlebot Video |

Googlebot-Video/1.0 |

Phân tích video, thumbnail và metadata liên quan |

|

Googlebot News |

Googlebot-News |

Chỉ hoạt động với các website đăng ký Google News |

Gợi ý tối ưu: Nếu bạn có nhiều hình ảnh, video hoặc nội dung dạng tin tức, hãy đảm bảo các tệp đó được cấu trúc dữ liệu chuẩn (schema), dễ truy cập, không bị chặn trong robots.txt để các bot chuyên biệt hoạt động mượt mà hơn, từ đó cải thiện tốc độ thu thập tổng thể.

Xem thêm Video chuyên gia của Google nói về Googlebot

- Ngày 4/11/2016 Google chính thức thông báo về việc thử nghiệm lập chỉ mục trên thiết bị di động đầu tiên thay vì lập chỉ mục trên máy tính để bàn như trước đây.

- Ngày 26/3/2018 Google chính thức đưa tin về việc ưu tiên lập chỉ mục trên thiết bị di động (Mobile First Indexing).

Tôi đã hoàn thành bài viết này với nguồn tham khảo từ:

- Yoast

- Raddinteractive.com

- Themeisle.com

- Youtube.