Thân chào các bạn,

Tôi tin rằng, khi bạn đọc bài viết này có thể bạn đã từng nghe tới thuật ngữ TF-IDF ở một mức độ nào đó. Trong trường hợp bạn chưa từng nghe thấy thuật ngữ này thì bài viết này sẽ cung cấp cho bạn khá nhiều thông tin hữu ích giúp bạn hiểu rõ về tf-idf là gì và cách tối ưu tf-idf để hỗ trợ SEO cho trang web.

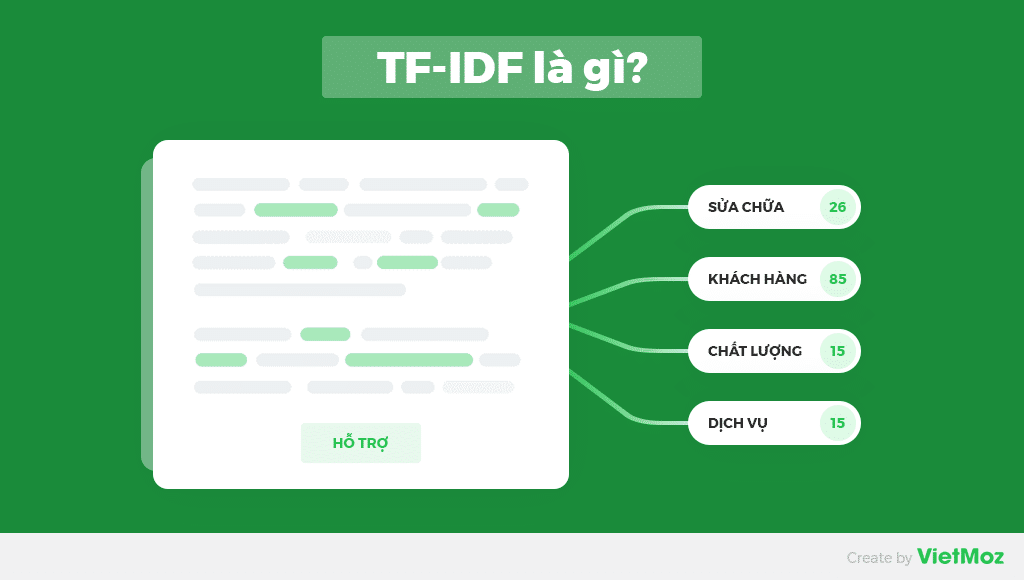

TF-IDF là gì?

Tf-Idf là từ viết tắt của Term Frequency (tần suất xuất hiện của từ) – Inverse Document Frequency (tần suất nghịch đảo văn bản)

Tf*idf là một chỉ số thống kê được sử dụng trong truy xuất thông tin để thể hiện tầm quan trọng của một từ hoặc cụm từ cụ thể đối với một tài liệu nhất định.

Wikipedia định nghĩa tf-idf như sau:

Tf-idf thường được sử dụng là một phần của lập chỉ mục ngữ nghĩa tiềm ẩn (LSI), đây là một kỹ thuật xử lý ngôn ngữ (cũng thường được gọi là xử lý ngôn ngữ tự nhiên, hoặc semantic NLP) và cho phép các hệ thống xếp hạng các tài liệu dựa trên mức độ phù hợp với thuật ngữ hoặc chủ đề cụ thể.

Bạn có thể tham khảo bài viết về định nghĩa về LSI mà tôi đã viết trên website vietmoz.edu.vn

Mục tiêu của phương pháp này là tìm hiểu ý nghĩa của một tập hợp nội dung phi cấu trúc để ghi điểm về nội dung và phản ánh mức độ ưu tiên của nó thể hiện chủ đề hoặc khái niệm đó so với các tài liệu khác trong cùng nhóm mẫu.

Những tài liệu liên quan tới tf-idf, semantic NLP hay Word2Vec không phải là thông tin mới nhưng tại thời điểm này thì vẫn có những tác động từ góc độ SEO.

Tần suất xuất hiện của thuật ngữ là gì?

Term Frequency là con số thể hiện thuật ngữ đó xuất hiện bao nhiêu lần trong tài liệu này. Nếu thuật ngữ đó xuất hiện càng nhiều thì trọng số càng cao.

Có thể hiểu đơn giản là khi một thuật ngữ được nhắc tới 5 lần thì thuật ngữ đó sẽ có khả năng liên quan hơn so với một nội dung chỉ nhắc tới thuật ngữ đó 1 lần.

TF- term frequency – tần số xuất hiện của 1 từ trong 1 văn bản. Công thức tính:

- Thương của số lần xuất hiện 1 từ trong văn bản và số lần xuất hiện nhiều nhất của một từ bất kỳ trong văn bản đó. (giá trị sẽ thuộc khoảng [0, 1])

- f(t,d) – số lần xuất hiện từ t trong văn bản d.

- max{f(w,d):w∈d} – số lần xuất hiện nhiều nhất của một từ bất kỳ trong văn bản.

Tần suất nghịch đảo văn bản

IDF – inverse document frequency. Tần số nghịch của 1 từ trong tập văn bản.

Tính IDF để giảm giá trị của những từ phổ biến. Mỗi từ chỉ có 1 giá trị IDF duy nhất trong tập văn bản.

- |D|: – tổng số văn bản trong tập D

- |{d D:t d\}|: – số văn bản chứa từ nhất định, với điều kiện t xuất hiện trong văn bản d (i.e., tf(t,d) 0}). Nếu từ đó không xuất hiện ở bất cứ 1 văn bản nào trong tập thì mẫu số sẽ bằng 0 => phép chia cho không không hợp lệ, vì thế người ta thường thay bằng mẫu thức 1+ | D:t d}|.

Cơ số logarit trong công thức này không thay đổi giá trị của 1 từ mà chỉ thu hẹp khoảng giá trị của từ đó. Vì thay đổi cơ số sẽ dẫn đến việc giá trị của các từ thay đổi bởi một số nhất định và tỷ lệ giữa các trọng lượng với nhau sẽ không thay đổi. (nói cách khác, thay đổi cơ số sẽ không ảnh hưởng đến tỷ lệ giữa các giá trị IDF). Tuy nhiên việc thay đổi khoảng giá trị sẽ giúp tỷ lệ giữa IDF và TF tương đồng để dùng cho công thức TF-IDF như bên dưới.

Giá trị TF-IDF:

Những từ có giá trị TF-IDF cao là những từ càng có liên quan trong tài liệu cụ thể.

Ví dụ về TF-IDF

Hãy xem xét 1 tài liệu dài 100 từ trong đó từ SEO xuất hiện 3 lần. Tần suất xuất hiện của từ khóa SEO (tức TF) là (3/100) = 0,03.

Bây giờ, giả sử chúng ta có 10 triệu tài liệu và từ SEO xuất hiện trong 1000 tài liệu. Khi đó tần số nghịch đảo văn bản (tức là IDF) được tính là log(10.000.000/1000) = 4.

Do đó, trọng số TF-IDF là 0,03 * 4 = 0,12.

Tìm hiểu về N-Grams

N-Gram là một tập hợp các từ cùng xuất hiện trong một nhóm văn bản nhất định. Đây được coi là một phần trong quá trình phân tích các chủ đề có trong tài liệu.

Để tính TF-IDF, các thuật ngữ thường được tính là unigram (thuật ngữ 1 từ), bigrams (thuật ngữ 2 từ) hoặc trigram (thuật ngữ 3 từ).

Ví dụ có 1 đoạn văn bản như sau: “SEO cần nhiều link để xếp hạng trang”, các bigram sẽ là:

- SEO cần

- cần nhiều

- nhiều link

- link để

- để xếp

- xếp hạng

- hạng trang

Như vậy trong ví dụ trên ta có 7 n-grams Nếu ta muốn xem xét các trigram trong câu này thì các trigram sẽ là:

- SEO cần nhiều

- cần nhiều link

- nhiều link để

- để xếp hạng

- xếp hạng trang

như vậy tổng số n-grams sẽ còn 5 nếu N=3

Khi nói tới việc xử lý tính toán đối với ngôn ngữ tự nhiên (đặc biệt là SEO), có vẻ như bigram và trigram thể hiện các chủ đề rất tốt.

Tầm quan trọng của TF-IDF và LSI trong SEO?

Các công cụ này có thể coi là nền tảng để xây dựng các công cụ tìm kiếm và cách Google đánh giá và liên kết các trang web của bạn với các từ khóa liên quan đến nội dung của tài liệu.

Google có hàng triệu – hàng tỉ trang để thu thập dữ liệu và chấm điểm mức độ liên quan của các chủ đề xoay quanh truy vấn của người dùng. Để trả về kết quả tốt nhất, Google cần xếp hạng các tài liệu này dựa trên mức độ phù hợp.

Không phải tất cả các tài liệu sẽ chứa các thuật ngữ liên quan đến truy vấn đó và một số thuật ngữ quan trọng hơn các thuật ngữ khác. Điểm liên quan của tài liệu, ít nhất là một phần dựa trên trọng số của mỗi thuật ngữ đó xuất hiện trong tài liệu.

Tại sao TF-IDF được sử dụng trong Machine Learning?

Machine Learning (máy học) với ngôn ngữ tự nhiên trước đây luôn xử lý các con số, nhưng với ngôn ngữ tự nhiên thì thuật toán cần phải xử lý dạng văn bản. Vì vậy để thuật toán cần chuyển đổi văn bản đó thành số (Text vectorize). Đây là bước cơ bản trong quá trình máy học phân tích văn bản và các thuật toán vector hóa khác nhau sẽ ảnh hưởng đến kết quả cuối cùng.

Google ứng dụng Machine Learning vào trong thuật toán xếp hạng để có thể nâng cao chất lượng kết quả trả về cho người dùng trên SERP.

Nói một cách đơn giản, khi chuyển hóa văn bản thành số (vector hóa tài liệu), số lượng các vector bằng cách nào đó đại diện cho nội dung của văn bản. TF-IDF giúp Google hiểu rõ mức độ phù hợp của từng từ trong tài liệu và cách liên kết của các từ trong tài liệu đó. Và sau đó tiếp tục hiểu các tài liệu tương tự với các vector tương tự.

Các ứng dụng của TF-IDF

Xác định TF-IDF có những lợi ích sau:

Lấy thông tin

TF-IDF đươc phát minh để tìm kiếm tài liệu và có thể sử dụng để cung cấp các kết quả phù hợp nhất với những gì bạn đang tìm kiếm.

Khai thác từ khóa

TF-IDF khá hữu ích để hỗ trợ quá trình trích xuất các từ và thành ngữ có liên quan nhất từ văn bản. Quá trình này giúp khám phá các từ khóa trong tài liệu của bạn.

Các từ có điểm cao nhất trong tài liệu sẽ có sự liên quan nhất đến tài liệu đó và được coi là từ khóa cho tài liệu đó.

Tổng kết

Có khá nhiều công cụ hỗ trợ tính TF-IDF như Website Auditor của SEO Powersuite. Với việc tính được TF-IDF của từng từ khóa bạn có thể điều chỉnh nội dung để thể hiện rõ hơn các thuật ngữ muốn nhấn mạnh trong bài viết bằng cách cải thiện tần suất xuất hiện của các thuật ngữ tương ứng.

Bài viết được tham khảo từ một số nguồn và nghiên cứu: